全球 AI 界的頂級盛會——英偉達 GTC 已經在美國西海岸的圣何塞正式開幕。昨天和今天,大半個中國智駕圈齊聚 GTC,暢談 2025 智駕未來。

商湯絕影 CEO 王曉剛、理想汽車智駕研發負責人賈鵬、元戎啟行 CEO 周光、小米汽車自動駕駛與機器人部楊奎元、卓馭 AI 首席技術官陳曉智先后發言,他們觀點中最核心的內容其實就在兩個方面,一是端到端智駕的落地,二是下一代 VLA 模型(Vision-Language-Action,視覺-語言-動作)模型。

就在今早,理想汽車和元戎啟行分別發布了 VLA 模型。李想發微博稱:「這是我們通往 L4 路上最重要的一步。就像 iPhone 4 重新定義了手機,MindVLA 也將重新定義自動駕駛。」

在落地時間上,這兩家最先在智駕領域推出 VLA 架構的公司也是不謀而合,理想 MindVLA 將與 i8 一同到來,元戎啟行計劃年中搭載進入多款車型。

2025 年的智駕競爭,VLA 會是非常關鍵的一環。

在智駕量產落地的過程中,「端到端」已經成為任何一家廠商都繞不開的技術。去年全年,小米汽車完成了高速 NOA - 基于規則的城市 NOA - 端到端智駕的三代技術路線升級,最新的端到端版本將用上超過 1,360 Clips 訓練的模型。商湯絕影的端到端智駕方案 UniAD 也將在今年正式量產上車。此外,卓馭也希望打造更具個性化的端到端智駕系統。

在實現端到端 + VLA 的背后,恰好是英偉達提供了核心算力以及大量的工具鏈。在中國智駕市場中,英偉達也一直占有核心的市場地位。面對華為、特斯拉等強勁對手的「圍剿」,英偉達和它的朋友圈如何應對 2025 年智駕的競爭,在本屆 GTC 上我們找到了答案。

理想發布 VLA 模型,動動嘴就能控車

也許過不了多久,語音也可以自如地指揮車輛智能駕駛了。比如我們想喝咖啡,于是就讓車找家星巴克,然后到了地方把我們放在門口。

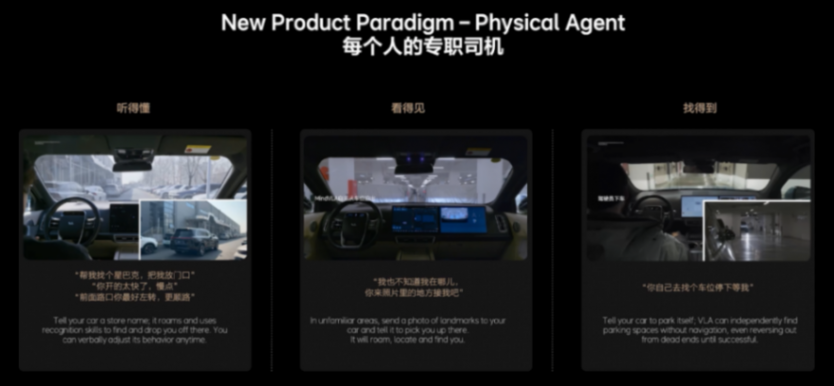

值得高興的是,這種場景并不是一種在腦海中的設想。在英偉達 GTC 大會上,理想智駕研發負責人賈鵬就通過視頻的方式演示了這種場景。

賈鵬還演示了另外兩種場景,一種是車主也不清楚自己在哪兒,但是可以呼喚車子來接;另一種則是車主先行下車,接著讓車子自行去尋找車位。

總的來說,賈鵬把這形容為「每個人的專職司機」,并且他還表示理想會「重新定義智能駕駛」。

之所以能夠實現這樣的場景,據賈鵬介紹,理想依靠的是 VLA 技術,也就是視覺語言動作模型(Vision-Language-Action Model),而理想則把自己的 VLA 技術稱作 MindVLA。

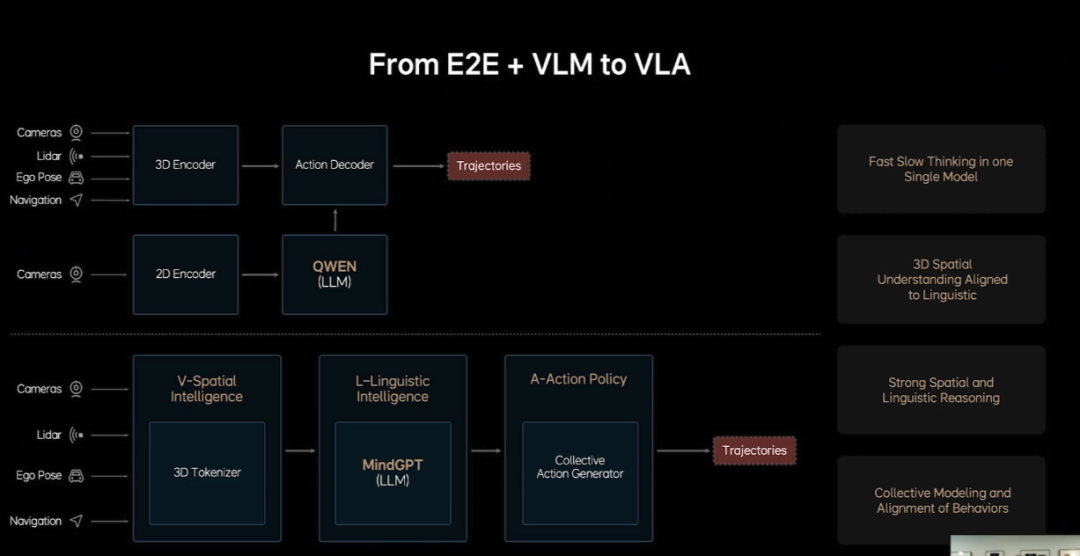

當前,理想的智能駕駛技術仍是端到端 + VLM。這套技術方案上車之后,不僅大幅提升了理想的智駕水平,而且還助推了 AD Max 車型銷量的增長。不過,賈鵬表示,端到端 + VLM 也有很多問題。

比如,端到端和 VLM 是兩個獨立的模型,要聯合訓練比較困難。此外,端到端 + VLM 還有對 3D 空間理解不夠、駕駛知識和內存帶寬不足、難以處理人類駕駛的多模態性等問題。

對于人類駕駛的多模態性,賈鵬專門做了進一步的解釋,就是指同樣一個駕駛行為,人不同的話,駕駛狀態也會不同。另外,即使是同一個人,心情不一樣的時候,開車的方式也會出現不同。

而 MindVLA,據賈鵬介紹,它并不是簡單粗暴地將端到端和 VLM 這兩個模型統一在一起,這其中有很多模塊都需要重新設計。在能力上,MindVLA 可以同步提高智駕的上限和下限,實現空間、行為和語言的統一。

具體地說,MindVLA 可以對 3D 空間有更好的理解;具備語言智能,可以理解車主的語音駕駛指令;能夠在世界模型中強化學習等。

最終,借助 VLA,理想就是要實現類似于開頭所說的那些駕駛場景。而等到那些駕駛場景真的落地的時候,車子也就更像是一個四輪機器人了。

小米楊奎元:端到端數據量超 1,360 萬 Clips

2021 年,小米汽車正式立項,當時楊奎元就已經加入小米汽車。四年來,他參與了小米 SU7 智駕的研發、量產到 OTA 的全程。

在本屆 GTC 上,小米汽車自動駕駛與機器人部楊奎元分享了小米端到端全場景智能駕駛在物理世界探索、建模方面的技術細節。

區別傳統的模塊化架構,端到端智駕從輸入端到輸出端只有一個模型,從之前的感知模型化,拓展到了感知規控模型化。對于端到端智駕來說,數據驅動和模型泛化能力至關重要。

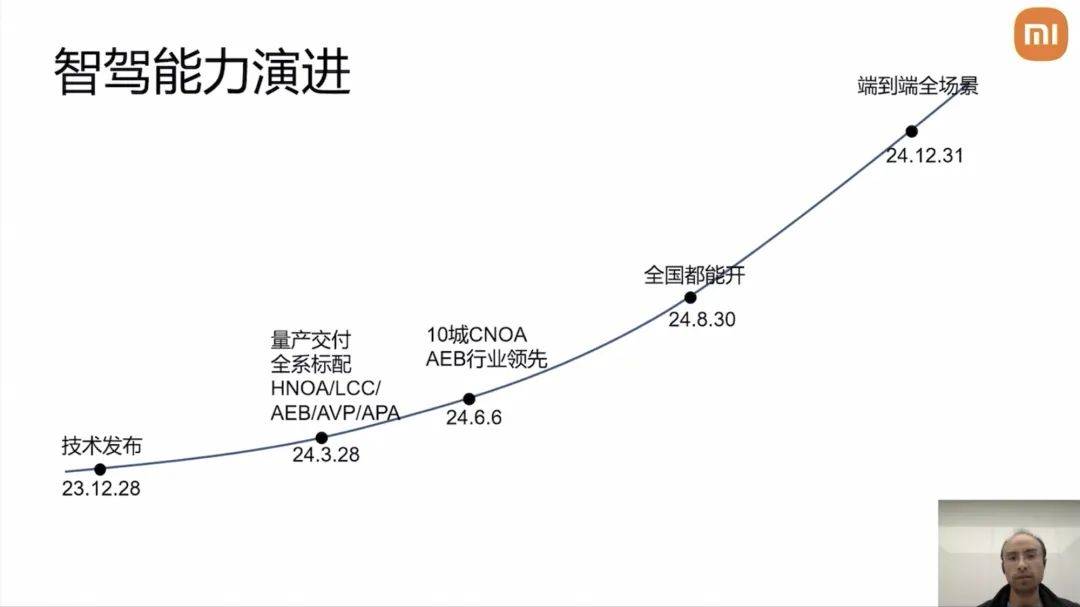

這也是小米智駕系統快速量產交付背后的秘密。2024 年 3 月,小米 SU7 交付即搭載高速 NOA;2024 年 8 月,實現 NOA 全國都能開;2024 年底,小米推送端到端先鋒版。目前,小米智駕系統為端到端 + VLM。楊奎元稱:「小米智能駕駛實現了一年追三代。」

楊奎元談到,無論是 SU7、SU7 Ultra 還是 YU7,小米在設計車輛的時候,充分考慮到了車輛對物理世界探索,以及實現高階智駕需求。從外觀上,傳感器選型和安裝上保持不同車型的硬件一致性,打好了規模化探索物理世界的硬件基礎。

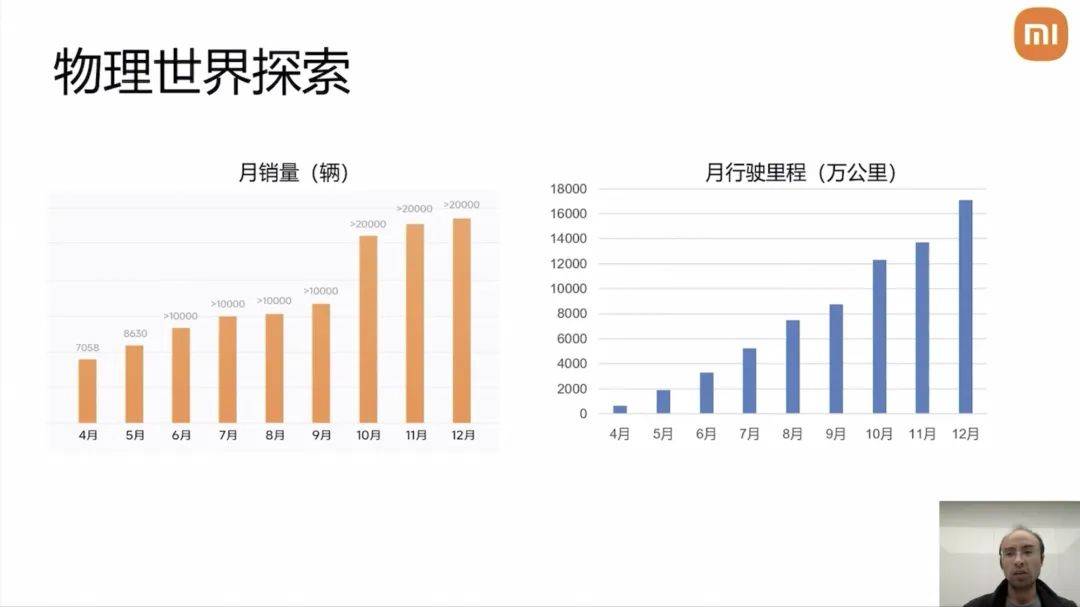

去年 3 月交付之后,目前參與物理世界探索的車隊規模已經超過 18 萬輛(今天下午小米汽車宣布交付已經突破 20 萬),同時還在以每月 2 萬輛的速度攀升。

車隊規模快速增長,也讓行駛里程快速增加。去年年底,車隊每天行駛里程 500 萬公里。目前,車隊每天行駛總里程接近 1,000 萬公里。

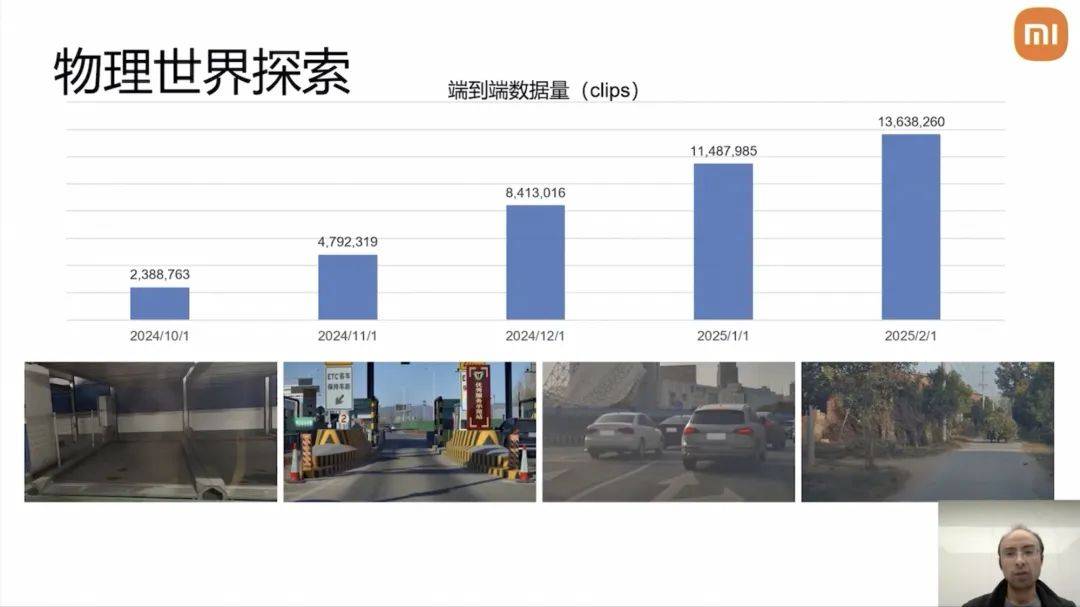

對于端到端智駕來說,停車場、ETC 收費站、城區環島、鄉村道路等就是難點場景。訓練這些場景則需要連續視頻片段(Clip)。在楊奎元的分享中,去年 10 月,小米汽車的訓練數據為 238 萬 Clips,經過四個月的累積,今年 2 月達到 1,363.8 萬 Clips。

楊奎元說:「這也是下一個千萬 Clips 端到端版本所用的訓練數據量。」

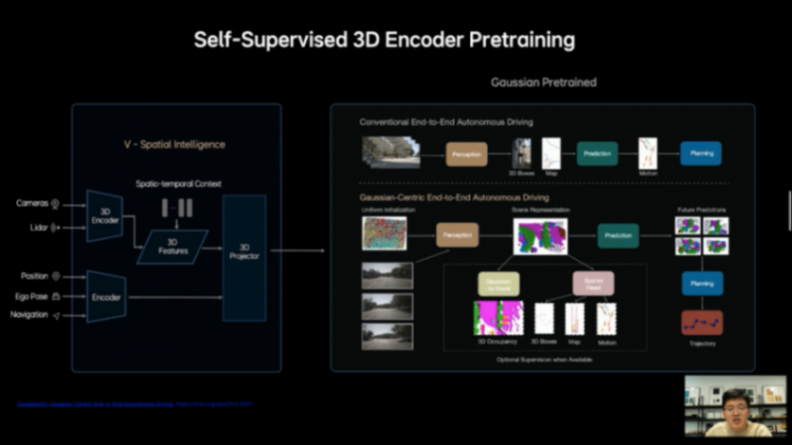

在擁有豐富的物理世界探索數據后,還需要對物理世界進行建模。

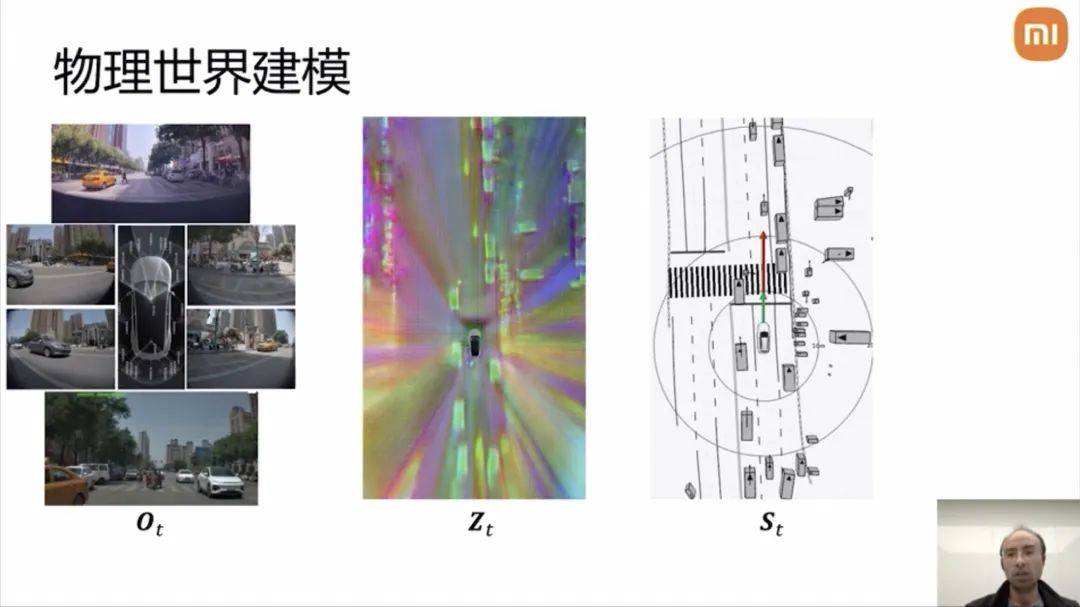

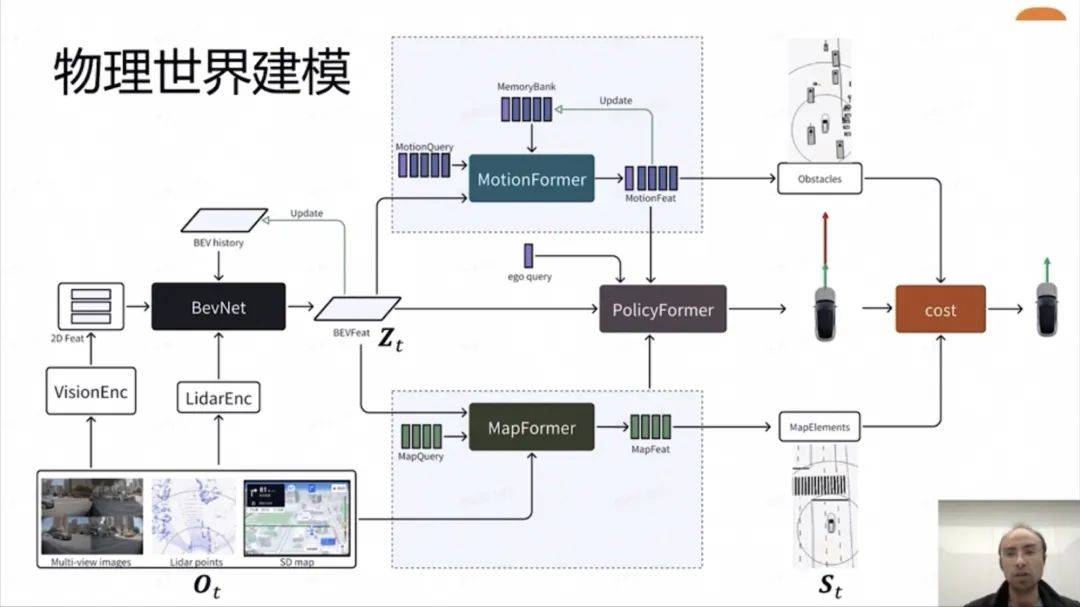

楊奎元指出,物理世界建模分為三層:分別是Ot(原始的數據觀測層,通過車身傳感器記錄物理世界)、Zt(深度神經網絡的隱式特征層,數據驅動的方式形成對當前場景的理解)、St(方便人理解和操作的顯示符號層)。

對應神經網絡中的輸入層、中間層以及輸出層。其中數據觀測層需要圖像、激光雷達點云、導航信息(Ot),通過 BEV 編碼網絡,得到 BEV 的隱式表達(Zt),通過不同的解碼器,得到動態元素、靜態元素、未來軌跡。經過不同的建模方式,最終經過人工建模的 Cost(包括碰撞 Cost、車道偏移 Cost、舒適性 Cost)約束軌跡的合理性。

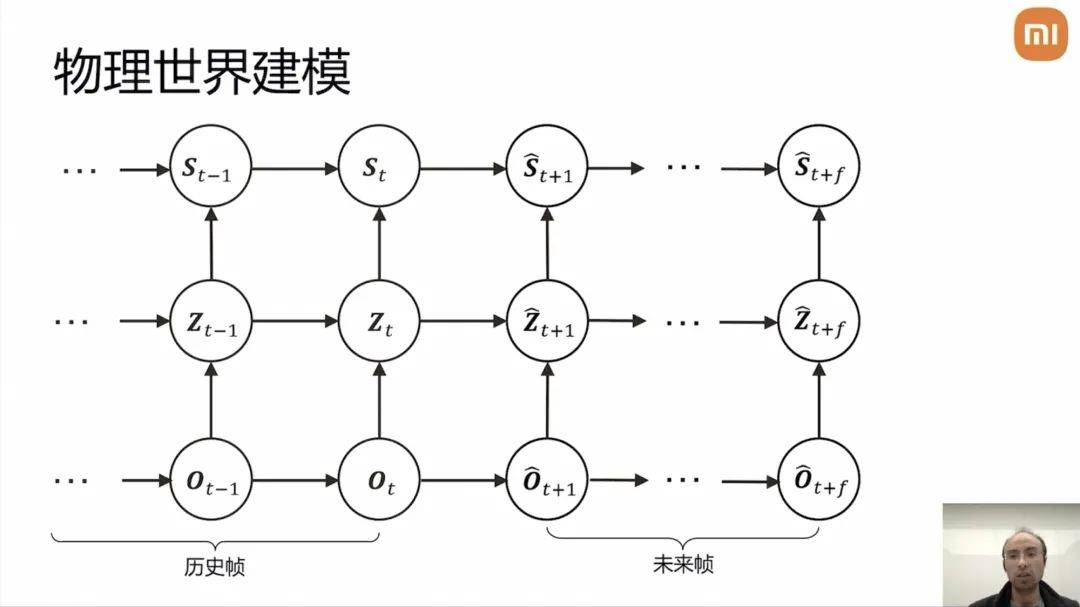

另外還有個時間維度,歷史幀很簡單建模容易,但是未來幀無法直接觀測,是建模的重點和難點。

數據觀測層(Ot)有很多工具可以使用,比如 3DGS 重建技術,或者是 OpenAI 的 Sora、英偉達 Cosmos 等等。生成大模型通過直接擬合原始數據的概率分布,加上額外使用歷史幀圖像、隱式特征、顯示符號等控制條件,可以進行原始信號的生成。這部分生成速度比較慢,主要在云端仿真物理世界,用于閉環仿真評測以及長尾數據生成。但是生成模型主要用于傳感器細節信號恢復,但是理解能力欠佳。當然,也有部分生成 + 理解的隱式特征空間。

智駕領域,還沒有成熟的基座模型可以用于生成穩定的特征表達。

顯示符號層,人工可以直接編碼操作,借助人類對物理世界已經具備的建模能力,通過規則代碼的方式和模型結合完成時序上的建模。比如勻加速、軌跡采樣等。

同時,小米正在嘗試將三層表達聯合起來的時序建模。還能將深度神經網絡模型上將中間的隱式特征在時序緯度上拓展到未來幀,由此可以形成完整的時空神經網絡模型,統一由數據驅動學習。在未來幀預測變化時,小米同樣對動靜態元素分開處理。

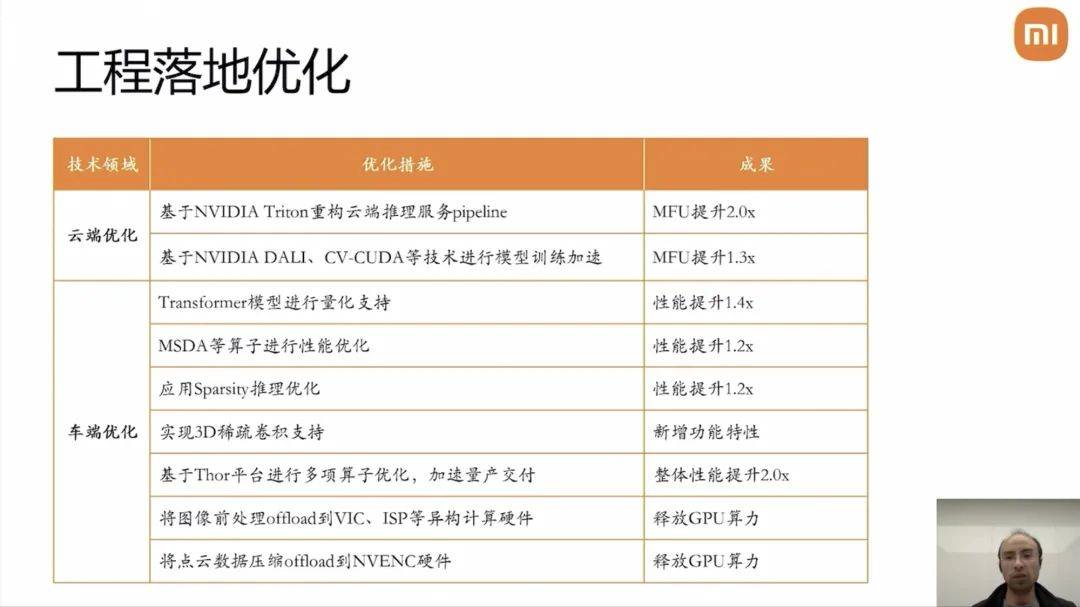

在工程落地上,小米與英偉達在云端、車端也進行了大量落地優化。

元戎啟行 CEO 周光:VLA 年中上車

周光在演講中首先談到了過去一年元戎啟行在智駕領域的進展。

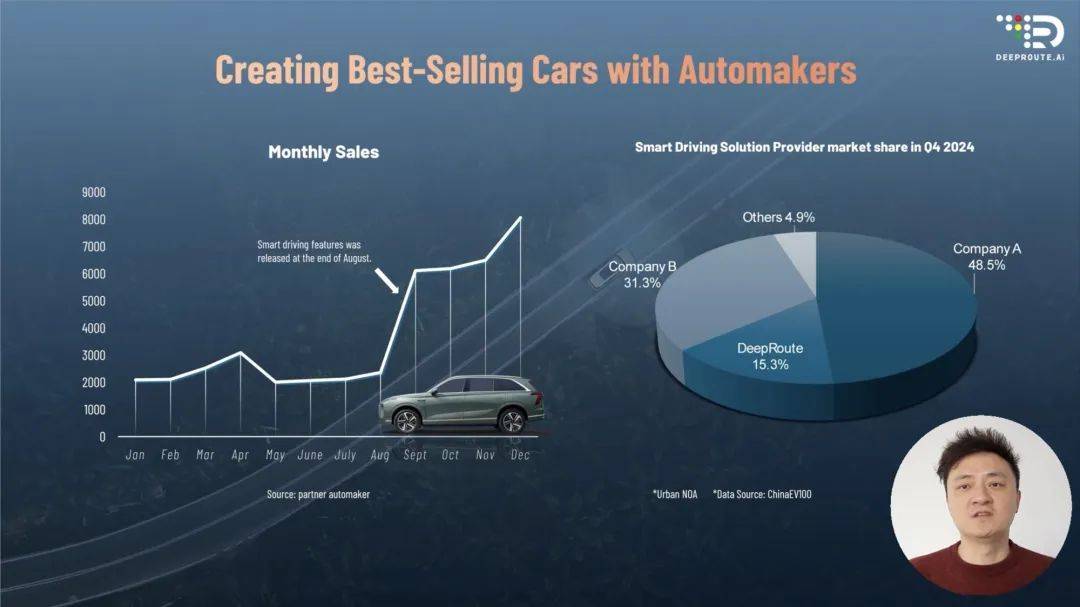

去年,元戎啟行智駕方案合作落地兩款車型(魏牌藍山、smart 精靈 5 號),今年預計將會推出十余款智能駕駛車型落地。在 2024 年第四季度,元戎啟行在國內城市智駕市場占有率達到 15.3%。

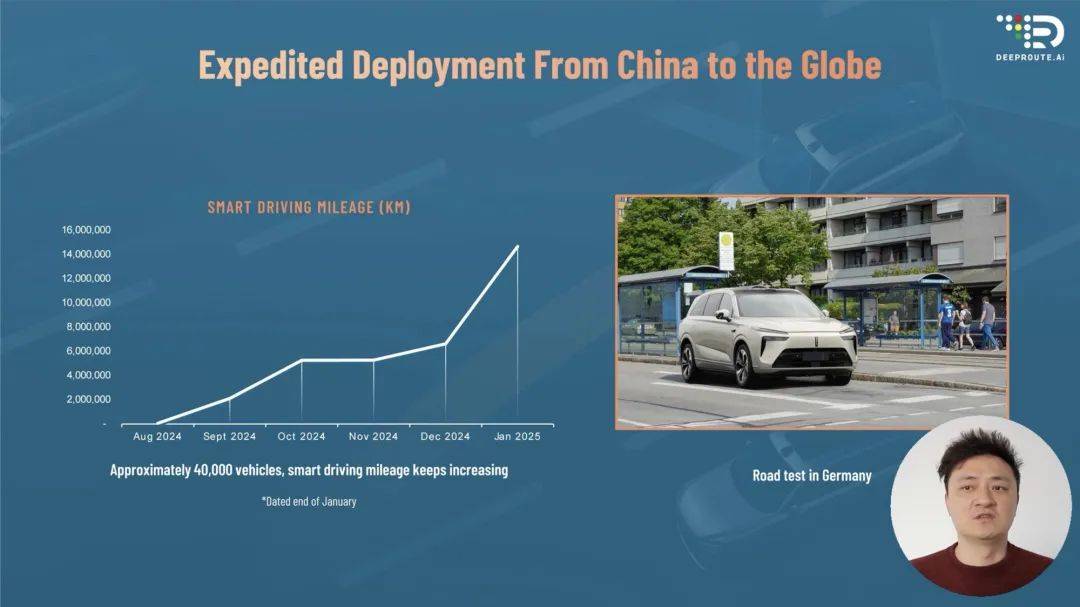

目前,元戎啟行的智駕方案已經搭載進入超過 4 萬臺汽車,截至 2 月底,元戎啟行智駕總里程 4,000 萬公里。周光預計,今年將有 20 萬臺進入市場,2026 年將有 50 萬臺車搭載元戎啟行的智駕系統。此外,元戎啟行已在德國進行路測。

在快速上車的同時,元戎啟行的下一代智駕系統也正在開發。去年 9 月,元戎啟行開始研發 VLA 模型,希望能夠用這套模型處理復雜的長尾場景。根據規劃,今年年中元戎啟行的 VLA 模型將部署在多款車型上。

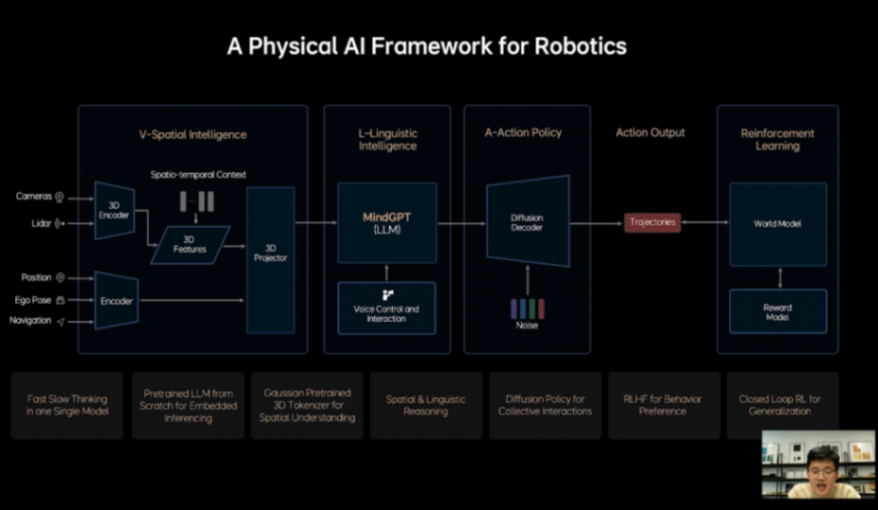

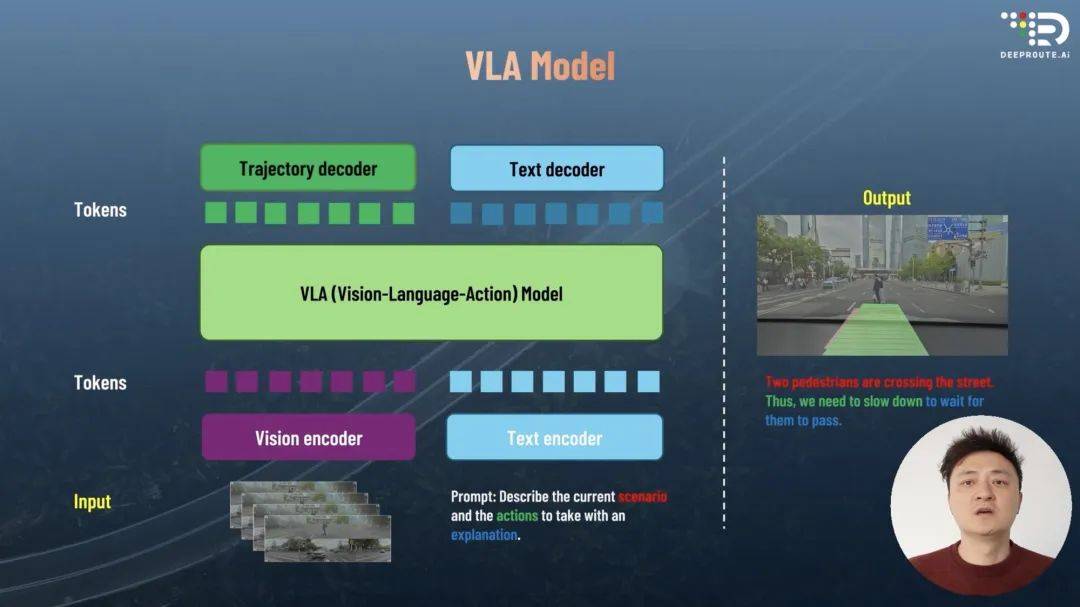

周光展示了元戎啟行 VLA 模型的架構:

-

最下方 Input 是輸入。其中有攝像頭等傳感器的圖像輸入,也有文本輸入,這可以是來自車內人員的指令輸入,或者是來源于智能座艙、導航的信息。

-

上一層是視覺編碼器和文本編碼器。其中,視覺編碼器負責處理輸入的圖像,提取特征。文本編碼器捕捉語義,理解文本指令。

-

再之上是視覺、文本融合,這也就是 VLA 模型的核心,讓模型同時理解圖像和文本的指令。

-

最終,輸出駕駛行為,以及文字輸出。

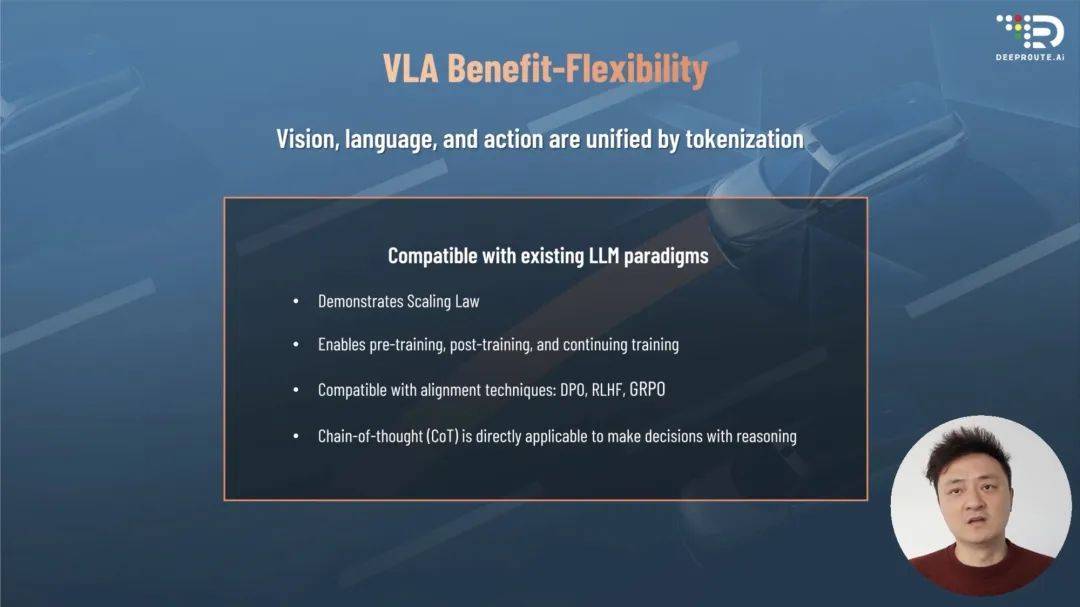

實際上,VLA 模型有相當多的優勢,其中最大優勢之一就是與現有的大語言模型范式兼容。其中 VLA 模型同樣遵從 Scaling Law,隨著模型參數提升,性能也會提升。同時,用預訓練、后訓練、持續訓練改進模型。同時還兼容 DPO、RLHF、GRPO 等技術。并且,思維鏈可以直接用于推理決策(潮汐車道的思考)。

VLA 的另一大核心優勢,則是可以讓智駕更像人。將基于規則的偏好注入模型,讓 VLA 符合人類預期的駕駛決策。這意味著,VLA 模型能夠識別并優先考慮安全的駕駛行為,從而減少現實世界中的不良習慣。此外,還能選擇人類偏好的最優路徑。

周光還專門講到了 VLA 的挑戰:

-

最重要的是實時響應的能力。基于英偉達 AGX 平臺,當前一代產品 VLA 的處理速度大約是 5 FPS,下一代平臺的速度是 20 FPS。

-

數據。需要豐富的現實世界數據,VLA 開發會優先使用現實世界數據,真實世界遠比模擬器復雜。

在 VLA 模型發布后,元戎啟行的下一個目標則是實現道路上的通用人工智能(RoadAGI)。

周光在演講中播放了這樣一段視頻,一輛帶有機械臂的無人配送車可以像外賣小哥一樣,實現城市內小區-小區,店鋪-店鋪的點到點自動駕駛。穿越閘機旁邊的狹窄通道,自動識別街邊店鋪之后,無人配送車來到取外賣的店鋪門口。店員把外賣裝進車里之后,無人配送車可以走人行道、過馬路送外賣。

第一單是送到外賣柜,這里高能,配送車里藏著一個機械臂,可以自動把外賣拿出來放進外賣柜里,然后關閉外賣柜。

第二單是送到寫字樓前臺,配送車自己過閘機,用機械臂自己按電梯,最后外賣放在公司前臺。

在演講中,周光并沒有透露是否量產這款無人配送車,但這樣的能力,或許就是元戎啟行對 RoadAGI 的設想。

商湯絕影王曉剛:端到端將在今年量產

在英偉達 GTC 上,商湯絕影 CEO 王曉剛宣布 UniAD 已經獲得項目定點,并且在今年就會量產。

UniAD 是商業絕影研發的一種端到端智駕方案,早在 2022 年,商湯絕影就提出了 UniAD。到了去年 11 月份,商湯絕影則正式發布了 UniAD。

值得注意的是,UniAD 基于英偉達 Drive AGX 平臺的 MIG 技術研發,支持端到端和傳統規則方案的雙系統運行。王曉剛表示,商湯絕影在此基礎上充分發揮了雙系統協同的作用,設計了首個量產級的、極致安全的端到端智駕解決方案,能在復雜交互場景中保障行車安全。

同時,王曉剛還介紹了商湯絕影的世界模型 —— 開悟。王曉剛表示,開悟可以理解真實世界中的物理法則和交通規則,生成場景也非常可控,能夠以「元素級別」的精度去控制場景,完全可以滿足端到端模型訓練和仿真對于數據質量的高要求。

開悟生產數據的效率也非常高。據王曉剛介紹,開悟基于 1 張英偉達 A100,平均每天的數據生產能力,大約相當于 100 臺路測車所擁有的數據采集能力。

此外,通過世界模型,開悟還能夠實現多樣化和真實的場景推演,以及專家軌跡生成,最終形成端到端智駕的數據閉環和自我迭代的能力。

針對開悟大模型的綜合實力,王曉剛表示它可以大幅降低端到端模型訓練的數據門檻,并在充分探索各種可能性的基礎上有望實現遠超人類的駕駛表現。

除了 UniAD,王曉剛還介紹了商湯絕影在智能座艙上的研發成果 —— A NEW MEMBER FOR U。

「A NEW MEMBER FOR U」是一個情感陪護伙伴,在去年 11 月份就發布了。據王曉剛分享,「A NEW MEMBER FOR U」感知敏感性、互動積極性都非常高,它可以持續推理用戶需求,記憶自我進化,記住用戶生活習慣,甚至是主動提醒在車內吃糖的小朋友少吃糖。

在體驗上,「A NEW MEMBER FOR U」依靠 Always-on 持續運行框架,可以做到零拷貝傳輸,并支持持續推理,推理速度高達每秒 96 tokens,針對復雜場景可以做到更實時的響應。

最后,王曉剛還介紹道,到 2026 年,商湯絕影將和英偉達完成艙駕融合產品在各大車廠的量產落地,并加速智能汽車進入 AGI 時代。

卓馭陳曉智:讓智駕更個性化

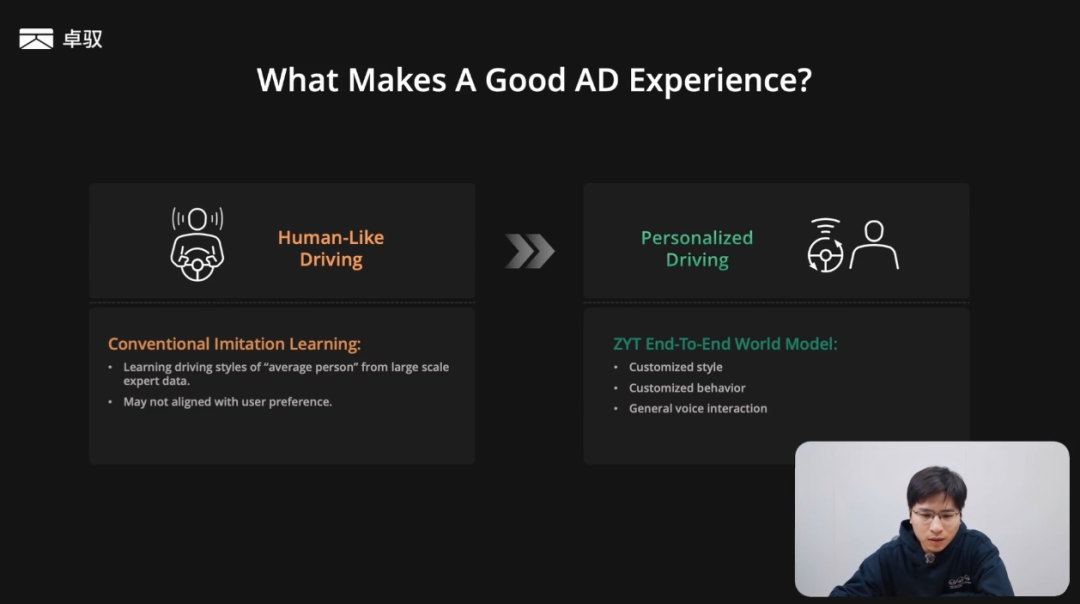

在英偉達 GTC 上,卓馭 AI 首席技術官陳曉智指出一個問題 —— 當前的端到端智駕,其通過數據訓練所學到的駕駛能力是一種平均風格,但在實際駕駛中,每個人都有自己的獨特的風格,所以端到端智駕與真實人駕還有很大的差距。

因此,在卓馭的目標中,就是令端到端智駕擺脫其平均駕駛風格,進而滿足用戶或激進、或保守的個性化駕駛需求。這里的個性化包括三點:

-

個性化的駕駛風格,需要系統在長時間維度上理解用戶駕駛行為;

-

個性化的駕駛風格,是指在某個具體的駕駛動作上符合用戶的個性化要求;

-

支持語音交互。

這套技術方案卓馭將其歸納總結為「生成式智駕體驗」。

為了實現「生成式智駕體驗」,據陳曉智介紹,卓馭首先是基于世界模型完成智駕的預訓練和后訓練,其中預訓練會以每周迭代的速度打牢智駕的基礎能力問題,后訓練則以每天迭代的速度解決長尾問題。

接著是端到端提示推理,用戶可以用語音來提示智駕,從而令智駕更清晰地知道用戶意圖,最終推理出符合用戶意圖的駕駛軌跡。

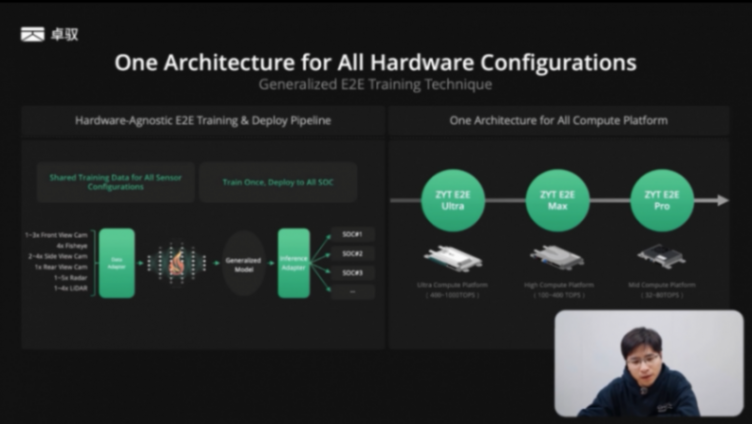

此外,陳曉智還介紹道,「生成式智駕體驗」適用于任何構型的硬件方案,并且對先驗地圖的依賴性也比較弱。

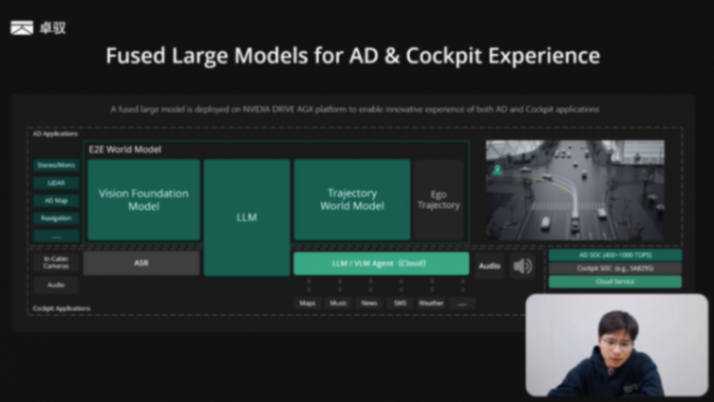

根據官方信息,卓馭的「生成式智駕體驗」基于英偉達 DRIVE AGX 平臺打造。同時,卓馭還基于該平臺打造了一套艙駕一體的融合大模型,陳曉智表示,簡單地說,其實就是智駕域和座艙域共享一套 LLM 大模型。

至于上述的「生成式智駕體驗」何時落地,陳曉智表示,卓馭在今年內就會將其量產。

06寫在最后

英偉達 GTC 大會已經見證了中國智駕領域的集體爆發,今年,VLA 模型與端到端技術正是通向更好用智駕的核心路徑。理想、元戎啟行等廠商率先推出 VLA 架構,通過融合語言指令與駕駛決策,讓車輛真正成為能理解人類意圖的「四輪機器人」。

在這場技術革命中,英偉達的算力底座與工具鏈成為關鍵推手,助力車企跨越感知、決策與執行的鴻溝。隨著 VLA 上車、端到端大規模量產,2025 年智駕競爭將聚焦于場景泛化能力與用戶體驗的個性化。當車企與科技公司攜手突破技術邊界,智駕正從功能模塊邁向通用人工智能(AGI),而這場變革的終點,或許是重新定義人與機器的共生關系。